Ascolta l’Audio dell’Articolo

Ascolta il Mini Podcast dell’articolo

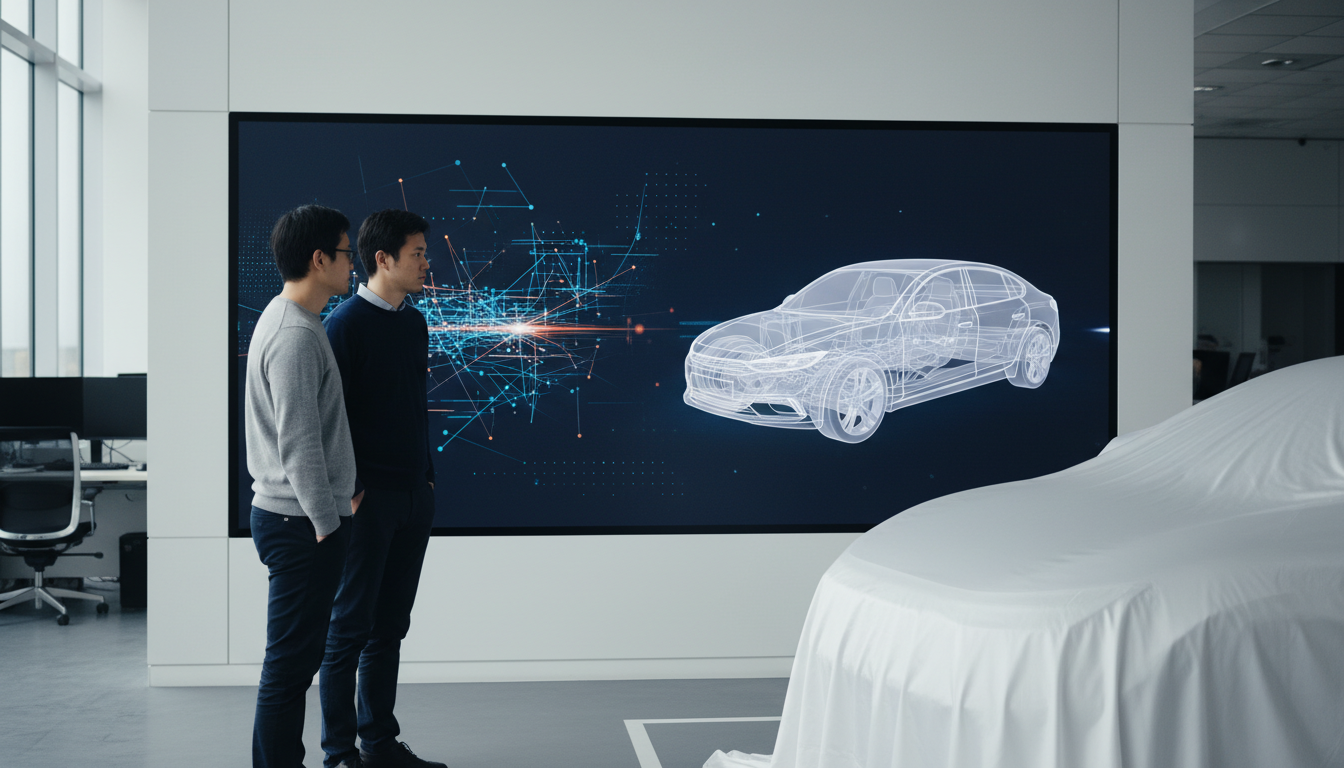

CES 2026, l’auto diventa software

Un tempo vetrina dei televisori e dei gadget più ambiti, oggi il CES di Las Vegas è diventato il luogo dove si misura la temperatura della mobilità globale. Nell’edizione 2026 il baricentro si sposta in modo netto: dall’hardware al software, dai cavalli ai calcoli. A imporsi sono intelligenza artificiale, connettività, piattaforme centralizzate e ADAS capaci di evolvere come uno smartphone, con aggiornamenti che aggiungono funzioni e valore nel tempo. Non è più (solo) una questione di design o di powertrain: il cuore dell’auto è una architettura digitale che integra assistenti intelligenti, sensori e servizi. Il messaggio che arriva dai padiglioni è chiaro: meno effetti speciali fini a se stessi, più concretezza e casi d’uso reali, con modelli sostenibili anche sul piano dei costi. In questo quadro, gli annunci di Ford, Arm e Hyundai delineano una traiettoria condivisa in cui l’auto smette di essere un oggetto isolato e diventa piattaforma intelligente al centro di un ecosistema di mobilità. Per una community come quella di Assodigit, che guarda con favore all’innovazione senza dimenticare l’etica, il segnale è incoraggiante: la tecnologia punta a migliorare l’esperienza, con attenzione a sicurezza, trasparenza e accessibilità, evitando derive di complessità o promesse irrealistiche.

In altre parole, il CES 2026 racconta un’industria che sta maturando: meno slogan, più sostanza e una bussola precisa che orienta sviluppo, produzione e servizi intorno a dati, AI e collaborazione uomo-macchina.

Ford punta sull’AI utile e accessibile

Al CES 2026 Ford riporta l’AI con i piedi per terra, trasformandola da parola d’ordine a strumento pratico. Il primo tassello è un assistente vocale evoluto, pronto a debuttare nelle app Ford e Lincoln e poi direttamente a bordo: comprenderà il contesto reale del veicolo e del conducente, dalle specifiche dell’allestimento alla capacità del bagagliaio, per risposte pertinenti ai bisogni quotidiani. Sullo sfondo c’è una scelta strategica: sviluppare in casa gran parte di software ed elettronica per controllare costi e complessità, evitando la corsa muscolare ai chip più potenti e puntando su un equilibrio intelligente tra prestazioni, dimensioni e prezzo finale. La stessa filosofia guida l’evoluzione della guida assistita: BlueCruise continua a crescere e il marchio fissa un obiettivo concreto, un sistema di guida autonoma di Livello 3 entro il 2028, con la possibilità di distogliere lo sguardo dalla strada in scenari selezionati. Il tutto sarà orchestrato da un “cervello” centrale capace di unificare infotainment, ADAS e comandi vocali su una nuova piattaforma elettrica universale, con un effetto diretto sui prezzi: la riduzione dei costi è stimata attorno al 30%, così da portare funzioni avanzate anche su modelli più accessibili e non solo su vetture premium. In ambito AI, l’approccio resta agnostico: porte aperte a soluzioni come Google Gemini, senza legarsi mani e piedi a un unico fornitore, per garantire scalabilità e indipendenza tecnologica.

- Assistente contestuale: prima su app Ford e Lincoln, poi a bordo, con comprensione del veicolo e delle esigenze del conducente.

- Sviluppo interno: controllo di costi e complessità, evitando la corsa ai chip più potenti.

- ADAS evoluti: BlueCruise prosegue; obiettivo Livello 3 con occhi “off” in situazioni specifiche entro il 2028.

- Piattaforma elettrica universale e cervello centralizzato: integrazione di infotainment, ADAS e voice.

- Efficienza: riduzione costi di circa il 30% e tecnologie estese a modelli più abbordabili.

- AI-agnostica: integrazione possibile di Google Gemini e di altri modelli, senza lock-in.

Arm e Hyundai, la robotica “fisica” entra nell’officina del futuro

Tra le novità più significative spicca la mossa di Arm, che al CES 2026 ha presentato la divisione “Physical AI”: non solo chip e licenze, ma una regia tecnologica pensata per portare l’AI a interagire con il mondo reale, coordinando sensori, calcolo e software perché robot e macchine comprendano l’ambiente e agiscano con precisione. È un tassello chiave per l’automotive, perché l’AI “fisica” non riguarda solo la guida autonoma: può ottimizzare fabbriche, magazzini e persino i servizi nei garage, con robot che collaborano con le persone nelle attività ripetitive o gravose. Qui si innesta la visione di Hyundai Motor Group, che al CES ha delineato una strategia di robotica human-centered applicata a tutta la catena del valore, dalla produzione al post-vendita. L’obiettivo non è sostituire gli operatori, ma affiancarli con sistemi collaborativi: il gruppo guarda a robot che lavorano insieme agli umani sulle linee entro il 2028, una prospettiva che dialoga con competenze già in casa, come quelle di Boston Dynamics. Il risultato è un ecosistema in cui l’auto diventa un nodo intelligente connesso a processi, logistica e servizi, capace di generare nuove opportunità di business e impatti positivi sulla vita quotidiana, dall’assistenza a persone con mobilità ridotta a percorsi di manutenzione personalizzati. Perché questa transizione sia virtuosa, resteranno centrali i principi etici: sicurezza degli operatori, affidabilità dei sistemi, governance dei dati e inclusione, per un’innovazione che mette davvero l’essere umano al centro.